AI 推理技術:從數據中心到邊緣運算

Table Of Contents

AI 推理技術:從數據中心到邊緣運算

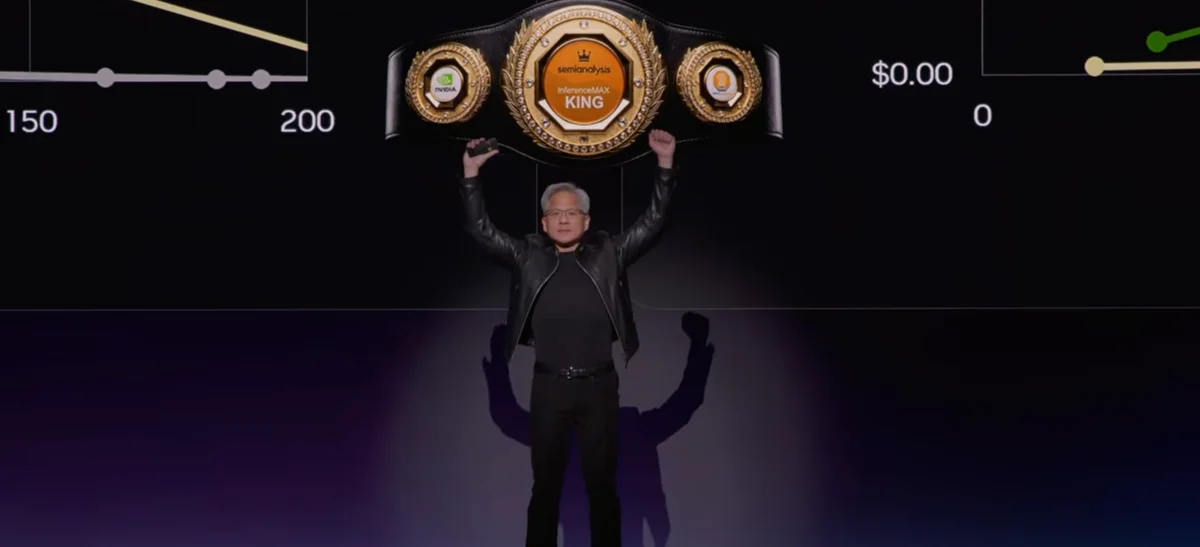

剛過去的 GTC 大會上,黃仁勳以「Token 之王」姿態出現,僅提及 10 餘次「訓練」(training),卻提到近 40 次「推理」(inference),凸顯了推理技術在 AI 發展中的核心地位。

香港 RISC-V 聯盟的戰略布局

2026 年 3 月,香港投資管理有限公司與賽昉科技(StarFive)宣布戰略合作,啟動「香港 RISC-V 聯盟」,致力發展以「獅子山芯」為代表的 RISC-V 高性能 AI 加速器技術。

賽昉科技由恆地李家傑旗下「賦生資本」孵化,專注於 RISC-V 開源晶片技術。同樣基於 RISC-V 架構的「進迭時空」已完成 6 億元 B 輪融資,其 K3-CoM260 開發板售價達 9,999 人民幣,據 CEO 陳志堅表示可運行 300 至 800 億參數的大型語言模型。

數據中心級解決方案

推理已成為龐大市場,各廠商紛紛推出專用產品:Google 有 TPU 等定制化 ASIC 晶片,AWS 則有 Inferentia 晶片,全部都是針對數據中心設計。

NVIDIA 發布的 Rubin Ultra 架構亦專注於數據中心,深度融合 Groq LPU 技術。Groq LPU 能將特定工作負載的吞吐量提升 35 倍,解鎖每秒 1,000 token 以上的生成速度。

破解能效瓶頸的關鍵技術

大模型推理的主要能效瓶頸源於權重數據在外部記憶體(如 LPDDR、HBM)與運算單元之間的頻繁搬運。人腦採用存算合一架構,而現有處理器和 GPU 架構的最大問題正是數據傳輸成本過高。

經典的馮·諾伊曼架構應用在推理上,最大的代價是數據搬運,故此 Groq LPU 放棄了經典的馮·諾伊曼架構,採用「存算近鄰/片上一體化」設計,使用全片上 SRAM(約 500MB)作為主存,數據在晶片內以流水線方式流動,幾乎無搬運延遲。

另一家美國公司 Cerebras 推出晶圓級 SIMD/空間並行架構,一片晶圓即為一顆晶片,擁有數萬個小核心並行工作,適合大模型訓練與推理。

香港大學 ReRAM-CIM 方案

香港大學開發的混合式存內運算(CIM)AI 處理器更加徹底,結合 ReRAM 與 SRAM 兩種技術的優勢,實現存算一體。然而,ReRAM-CIM 依賴類比訊號,存在精度損失和工藝變異敏感等問題。

邊緣推理的革命性突破:TOM 與 ROMA

加拿大初創公司 Taalas 提出的「模型即晶片(Model-on-Chip)」方案,運行 Llama 3.1 8B 速度達到每秒 17,000 tokens。

去年,上海交通大學及微軟亞洲研究院推出的 ROMA,利用高整合密度、低功耗的唯讀記憶體(ROM)固化基座模型權重,SRAM 儲存 LoRA 適配器,巧妙解決了記憶體牆與靈活性的矛盾。今年,上海交通大學、輝羲智能及微軟亞洲研究院的團隊發表了更具突破性的研究,他們推出的 ROMA(唯讀記憶體加速器) 與 TOM(三元唯讀記憶體加速器 Ternary Read-only Memory Accelerator),成功將 LLM 的邊緣推理速度推向每秒 20,000 tokens 的水準。上述兩家公司都集中以 ROM 和 SRAM 儲存結合。

ROMA 的技術優勢

ROMA 採用 7nm 製程,晶片面積約 500 mm²,可完整容納 4bit LLaMA3.2-3B 或 2bit LLaMA3-8B,推理性能達到每秒 20,000 tokens!團隊研究推出精度更高版本,加上體積小和功耗低,相比之下,SRAM 方案(如 Cerebras)僅能在晶圓級實現大容量,無法用於邊緣小晶片。

TOM 的進一步優化

TOM 再利用三元權重稀疏性將 ROM 密度提升 4 倍,面積縮小 89%,功耗降低 84%。透過 SRAM 層支援 QLoRA 微調,解決了 ROM 不可改寫的靈活性問題,架構巧妙運用了兩種記憶體的特性:ROM 唯讀性適合儲存長期固定的 LLM 基礎權重,TOM 大幅減低成本,SRAM 的可讀寫性則適合儲存需動態更新的數據,如 KV 快取和 QLoRA 低秩適配器矩陣。

應用場景與局限性

邊緣運算的廣闊前景

TOM/ROMA 採用 ROM+SRAM 混合架構,在小晶片面積、低功耗、高性能、高靈活性之間實現平衡,特別適合:

- 機器人等具身智能

- 無人機

- 家電產品

- 太空探索和海底機器人(ROM 功耗低且可應付嚴峻環境)

- 手機內建 LLM,實現極速推理與人機互動

數據中心場景的限制

TOM/ROMA 屬於單晶片解決方案,提供有限算力。SRAM 僅儲存 LoRA(數十 MB),無法支援全面參數微調、持續預訓練、模型蒸餾、混合專家(MoE)等應用。

此外,支援的模型規模較小(TOM 驗證 BitNet-2B,ROMA 支援 LLaMA3-8B 但代價是面積與功耗激增)。更重要的是,無高速片間互聯(如 NVLink、InfinityFabric),無法組成多晶片模組或擴展到機架/集群。

NVIDIA 的 NCCL 是 GPU 集群的絕對優勢,實現數據不經過 CPU/主存的卡對卡直接通信。沒有 NCCL,GPU 集群根本無法運行 70B/400B 級別的模型。

結論

TOM/ROMA 的突破性在於為邊緣推理提供了高效能、低功耗的解決方案,可能成為中國工業 5.0 的關鍵技術。然而,數據中心級的大規模推理仍需依賴 NVIDIA 等廠商的 GPU 集群方案。

未來的 AI 推理市場將呈現明確分工:邊緣運算側重於快速響應與低功耗,數據中心則專注於大規模模型的訓練與推理。兩者各有所長,相輔相成。